- The Autopilot

- Posts

- Codex + Claude Code

Codex + Claude Code

GPT 5.4 jetzt direkt in deinem Claude Code Terminal. So nutzt du es ab heute...

Hi ,

OpenAI hat letzte Woche das Codex Plugin für Claude Code released. Das heisst: Du kannst jetzt GPT 5.4 direkt aus deinem Claude Code Terminal heraus nutzen, ohne die Umgebung zu wechseln. Zwei der stärksten Modelle der Welt, zusammen in einem Workflow.

Warum mich das so flasht? Weil es ein Problem löst das mich seit Monaten nervt.

Der Koch der sein eigenes Gericht bewertet

Kennst du das: Claude schreibt Code, du lässt Claude den Code reviewen, Claude sagt "sieht gut aus." Und dann findest du den Bug in Production.

Das liegt daran dass jedes Modell blinde Flecken für seine eigenen Muster hat. Claude erkennt seine eigenen Gewohnheiten nicht als problematisch, genau wie ein Koch der sein eigenes Essen immer "ausgezeichnet" findet. Anthropic hat das in ihrem Harness-Paper selbst beschrieben: Wer seine eigene Arbeit bewertet, ist systematisch zu optimistisch.

Die Lösung: Ein anderes Modell reviewen lassen. Und genau das macht das Codex Plugin jetzt mega einfach.

Cross-Model Review: Claude schreibt, Codex prüft

Der Workflow ist simpel: Claude schreibt den Code. Codex (GPT 5.4) reviewed ihn. Claude fixt die gefundenen Issues. Zwei verschiedene Modelle mit verschiedenen Trainings, verschiedenen Gewohnheiten und verschiedenen blinden Flecken. Was Claude übersieht, fällt Codex auf.

Das Codex Plugin bringt zwei Review-Befehle mit:

/codex:review macht einen normalen Code Review auf deine aktuellen uncommitted Changes. Read-only, ändert nichts an deinem Code. Perfekt bevor du pushst.

/codex:adversarial-review geht tiefer: Es hinterfragt auch die gewählte Implementierung und das Design. Nutze ich wenn ich wissen will ob meine Lösung tatsächlich optimal ist. Auch read-only.

Bei grösseren Changes kann das Review eine Weile dauern. Codex bietet dir an es im Hintergrund laufen zu lassen. Status checkst du mit /codex:status.

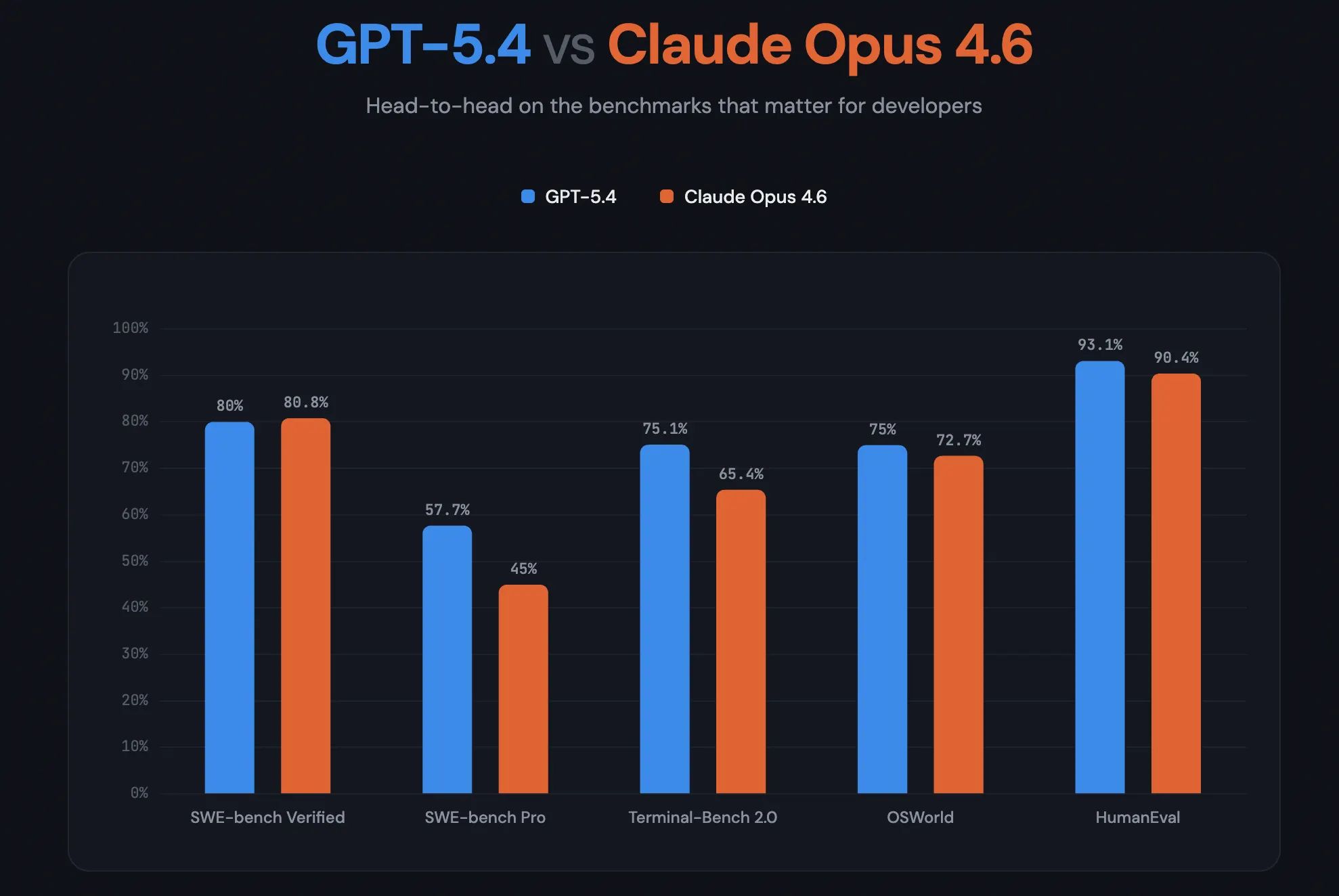

Wo welches Modell stärker ist

Kurzer Reality Check, weil die Frage sofort kommt: Brauche ich das überhaupt wenn Claude so stark ist?

Die Benchmarks zeigen: Auf SWE-bench Pro (dem realistischeren Coding-Benchmark) liegt GPT 5.4 bei 57,7% und Opus 4.6 bei etwa 45%. Bei komplexer Code-Analyse hat GPT die Nase vorn. Dazu kommt: GPT 5.4 ist halb so teuer beim Input ($2.50 vs. $5.00 pro Million Tokens) und 40% günstiger beim Output.

In der Praxis hat jedes Modell klare Stärken. Codex produziert oft visuell poliertere Frontend-Ergebnisse. Wenn du einen Prototypen brauchst der sofort gut aussieht, ist Codex die schnellere Wahl. Claude dagegen ist stärker bei Backend-Architektur, Multi-File Refactoring und komplexem Planen. Claudes Plan Mode ist beim strukturierten Aufsetzen grösserer Builds immer noch überlegen.

Die Schwächen sind genauso klar verteilt. Claude neigt dazu Lösungen zu over-engineeren, du fragst nach einer einfachen Funktion und bekommst eine Architektur die für zehn Jahre skaliert. Codex wiederum produziert manchmal rigidere Namensgebung im Code. Kein Modell ist perfekt, aber zusammen gleichen sie sich aus.

In 3 Minuten installiert

Du brauchst einen ChatGPT Account. Gute Nachricht: Ein kostenloser reicht.

bash

# Schritt 1: OpenAI Marketplace hinzufügen

/plugin marketplace add openai/codex-plugin-cc

# Schritt 2: Codex Plugin installieren

/plugin install codex@openai-codex

# Schritt 3: Mit ChatGPT Account verbinden

/codex:setupBei Schritt 2 wirst du gefragt ob für das aktuelle Projekt oder alle Projekte. Nimm "Install for you", dann ist es überall verfügbar. Bei Schritt 3 öffnet sich ein Browser-Fenster für den Login.

Wichtig: Dein Projekt braucht ein initialisiertes Git Repository. Codex startet mit git status und bricht ab wenn kein Git vorhanden ist.

Prüf mit /codex ob alles läuft. Falls das Plugin nicht auftaucht: /reload-plugins.

Mein täglicher Workflow damit

So nutze ich es seit einer Woche:

Claude schreibt den Code (Backend, Architektur, Logik)

Vor dem Commit:

/codex:reviewlaufen lassenBei grösseren Entscheidungen zusätzlich

/codex:adversarial-reviewClaude fixt die von Codex identifizierten Issues

Dann

/ce:compoundaus dem KW13 Stack um das Gelernte festzuhalten

Der Unterschied zum Self-Review ist spürbar. Codex findet Dinge die Claude durchwinkt. Besonders bei Edge Cases und Performance-Fragen.

Modelle selbst testen nach dem Anthropic Subscription-Stopp

Anthropic hat gerade die Subscription-Nutzung in Third-Party Tools wie OpenClaw beendet. Im heutigen Paid Newsletter zeige ich dir:

Mein Framework um neue Modelle in der Praxis zu evaluieren

Der Test mit Gemma 4, MiniMax 2.7, Qwen 3.5 und Kimi 2.5

Welches Modell für welchen Agent-Typ am besten funktioniert

Dieses fortgeschrittene Tutorial ist exklusiv für Premium-Mitglieder verfügbar. Du erhältst:

Komplettes Video-Tutorial

Fertigen Blueprint zum Kopieren

Zugang zu allen künftigen Premium-Tutorials

Wenn du dich bereit fühlst, dann kann ich dir folgendermaßen helfen:

1) KI ohne Team - 40+ Unternehmer sind schon dabei. Die KI Agenten Community für Menschen die was umsetzen wollen. Fertige KI-Systeme, die du lädst und sofort einsetzt. Jede Woche neue. Von Leuten, die damit ihr eigenes Geschäft betreiben.

2) KI Agenten Management Framework Paperclip - Das One-Click-Deployment für Paperclip. Mach dir selbst keinen Kopf mehr um das technische Setup. Lass den Agenten einfach für dich arbeiten. => Mit SASCHA10 bekommst du auch Rabatt im Checkout.

3) Lead-Gen-System für dein SaaS Produkt - ich habe ein Lead-Gen-System, das auf KI und den aktuellsten Marketing-Trends basiert und dir nachhaltig Leads generiert.

Reply